CanIRun.ai 是一款专注解决 AI 模型本地部署硬件适配难题的在线工具,专为开发者、AI 爱好者与企业用户打造。随着大语言模型(LLM)快速普及,越来越多人想在个人电脑、服务器本地运行各类 AI 模型,但不同模型对 GPU、CPU、内存的配置要求差异极大,手动核对参数门槛高、易出错,常出现模型下载后无法运行的情况。CanIRun.ai 依托自动化硬件检测与智能匹配算法,无需安装插件、不用注册登录,打开网页即可快速生成清晰直观的硬件适配报告,精准判断设备能否流畅运行目标 AI 模型。

CanIRun.ai 官方访问地址:https://www.canirun.ai/

CanIRun.ai 核心功能、工作原理与使用指南

核心功能与工作原理

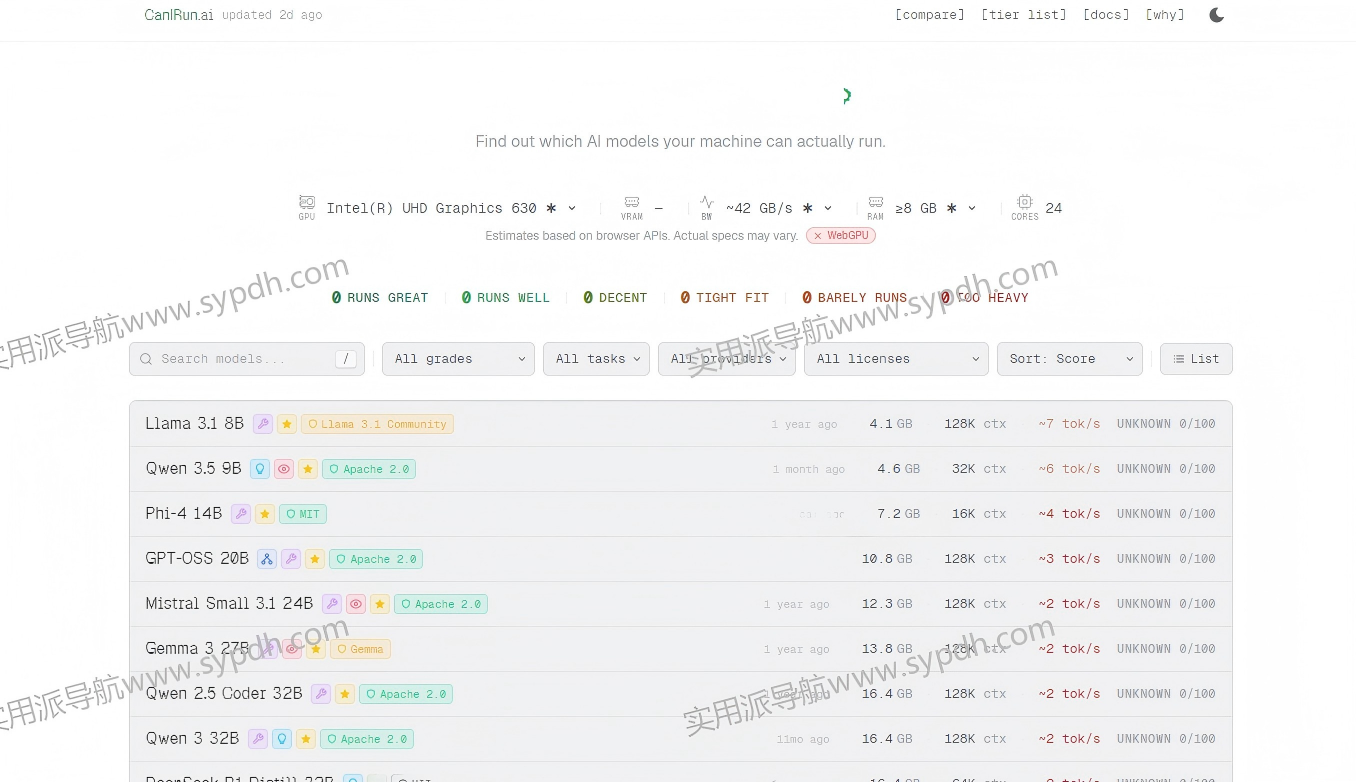

CanIRun.ai 的核心价值在于自动识别用户设备硬件配置,并智能分析当前环境能够本地运行的 AI 模型。其核心技术依靠浏览器内置 API(如 WebGPU)获取设备硬件信息,用户无需安装任何软件,打开网页即可完成自动扫描,快速获取 GPU 型号、显存大小、内存容量以及 CPU 核心数等关键参数。

系统会将这些硬件数据与后台庞大的 AI 模型配置库进行精准比对,根据模型大小、显存需求、量化等级以及运行框架,自动判断设备的适配情况。最终结果以清晰的列表形式展示,每个模型都会标注详细参数,包括参数量、上下文窗口长度、量化方案(如 Q4_K_M)以及适用场景(对话、编码、推理、多模态等)。

平台还采用 S、A、B、C、D、F 等级体系,直观反映模型在当前设备上的运行效果,从流畅运行到无法承载一目了然。用户还可以根据评分、参数量、显存占用、任务类型等条件自由筛选和排序,快速找到最适合自己硬件的 AI 模型。

产品特色与优势

一站式硬件检测与模型匹配

CanIRun.ai 将原本复杂、专业的硬件评估流程简化为一键式操作,大幅降低 AI 模型本地部署的难度。开发者可以在项目前期快速筛选适配模型,普通用户也能避免下载超大模型后无法运行的问题,节省时间与流量成本。

覆盖海量主流 AI 模型

平台支持 Meta Llama、阿里巴巴通义千问(Qwen)、微软 Phi、谷歌 Gemma、DeepSeek、Mistral 等主流机构的模型,涵盖从 1B 以内的轻量边缘模型到 600B 以上的超大模型,支持对话、代码、多模态、专用推理等多种类型。

实时更新,数据准确可靠

AI 模型迭代速度极快,CanIRun.ai 保持模型库与硬件信息持续更新,确保用户获取的配置要求、量化方案和运行建议都是最新、最准确的,避免因信息滞后导致部署失败。

大幅降低 AI 本地化门槛

无论是使用普通笔记本的个人用户,还是需要评估服务器资源的企业团队,都能通过 CanIRun.ai 快速获得专业的硬件适配建议,让 AI 本地化部署不再依赖高深技术背景,真正实现 AI 技术普惠化。

典型使用场景

AI 开发者

在开发聊天机器人、智能助手等应用时,可通过 CanIRun.ai 快速评估开发机或服务器配置,选择性能匹配、成本合理的模型,提升开发效率与稳定性。

AI 爱好者与研究者

想要在本地运行最新大语言模型或图像模型进行测试、体验时,可提前检测显卡显存与内存是否达标,避免下载几十 GB 模型后无法运行,减少不必要的资源浪费。

企业与机构 IT 部门

企业在引入 AI 业务前,可通过 CanIRun.ai 评估现有服务器与电脑设备,选择无需大规模硬件升级即可运行的模型,实现低成本、高效率的 AI 技术落地。

如何使用 CanIRun.ai

CanIRun.ai 的使用流程简单直观,无需注册、无需插件:

- 打开 CanIRun.ai 官方网站。

- 系统自动检测并展示你的硬件配置,包括 GPU、显存、内存、CPU 等。

- 页面自动生成按适配度排序的 AI 模型列表。

- 可根据参数量、显存需求、评分、任务类型(chat、code、vision)进一步筛选。

- 点击模型查看详细规格与运行建议,选择最适合本地部署的模型。

总结

CanIRun.ai 是连接硬件设备与 AI 模型的重要工具,它通过自动化检测与智能匹配消除了本地部署的不确定性,让普通用户、开发者与企业都能轻松判断设备能否运行目标 AI 模型。在 AI 快速普及的今天,CanIRun.ai 凭借简单、高效、专业的特点,成为本地部署 AI 模型必不可少的实用工具。

相关导航

暂无评论...